Бұл материалда Майкл Джексонның өзі Tengrinews.kz оқырмандарына үндеу жасады: "Алаяқтардан сақ болыңыздар!".

Көзбен көргенге сенетін әлем біртіндеп өткенге айналып бара жатыр. 2026 жылы адамның жүзі, дауысы, тіпті көзін ашып-жұмғаны және тыныс алу мәнері алаятықтың кілтіне айналуы мүмкін.

Бұл мақалада редакция тілшісі сарапшылармен бірге "бейкүнә ойынның" қалай киберқылмыскерлердің тиімді қаруына айналғанын, цифрлық шығармашылық пен қылмыстық жауапкершіліктің шекарасы қайда екенін және ең бастысы – қарапайым қазақстандық өзін жаңа ЖИ-қатерлерден қалай қорғай алатынын талдайды. Ал мұның қаншалықты оңай жасалатынын көрсету үшін редакция мамандардан оқырмандарға арнап жұлдыздың жалған видеосын жасап көруді сұрады.

Дипфейктер қалай пайда болды?

Барлығы әлеуметтік желілердегі қарапайым фильтрлер мен Голливуд фильмдеріндегі актерлерді "жасарту" технологияларынан басталды. Бірақ 2026 жылға қарай бұрын тек киностудияларға қолжетімді болған технологиялар әрбір смартфонға енді. Бүгінде шынайы видео мен бағдарламалық кодтың арасындағы шекара соншалықты жойылған, экранға сену қауіпті бола бастады.

Қазақстандықтар үшін алғашқы белгі – әлеуметтік желілерде тараған вирустық видеолар болды. Онда әлемдік жұлдыздар қазақша сөйлеп немесе жергілікті көрікті жерлерге сүйіспеншілік білдіріп жатты. Қолданушылар мұндай трендтерге қуанып жатқанда, сырт көзге қызық көрінген бұл видеолар артында қара нарық қалыптаса бастады: бөтен адамның бетжүзін пайдалану ақша ұрлаудың тиімді құралына айналғанын түсінген алаяқтар дипфейктерді белсенді қолдана бастады.

Көп ұзамай қазақстандық "жұлдыздар" да видеода "таңғажайып табыс табу жолдары" туралы айта бастады.

Кейін технологиялар одан әрі жеңілдеп, арзандап, кез келген қарапайым қазақстандықтың бейнесімен жеке дипфейк жасау мүмкін болды. Мысалы, Қостанай тұрғынына "Киану Ривз" қаржылай көмек сұрап хабарласқан жағдай тіркелген.

Бұл қауіпке қарсы тұру үшін алдымен алаяқтықтың қалай жұмыс істейтінін түсіну керек.

2026 жылы ЖИ-алаяқтық қалай жұмыс істеп жатыр?

Арнайы алгоритм (нейрожелі) нақты адамның суреттерін, видеоларын немесе дауысын зерттейді. Ол адамның бет бұлшықеттерінің қозғалысын, көзқарасын, сөйлеу интонациясын толық "есте сақтайды". Содан кейін бір адамның бетбейнесін немесе дауысын екінші адамның әрекетіне "беттестіреді".

2026 жылы дипфейктер үш негізгі түрге бөлінеді:

- Face Swap (бет-әлпетті ауыстыру) – танымал адамның бетжүзі басқа адамның денесіне қойылады. Мысалы, "Брэд Питт" Семей жағалауында жүргендей көрінеді.

- Voice Cloning (дауыс көшіру) – ЖИ-ге адамның дауысын көшіру үшін небәрі 3–5 секунд жеткілікті. Бұл WhatsApp-тағы алаяқтардың басты құралы.

- Real-time Deepfake (нақты уақытта дипфейк) – ең қауіпті түрі, видеоқоңырау кезінде адамның бейнесін бірден ауыстыруға мүмкіндік береді (Zoom, Telegram).

Негізгі қауіп неде?

Бұрын мұндай эффект жасау үшін кәсіби киностудияларға апталар қажет болатын. Ал қазір "цифрлық егізіңізді" 30 минутта қарапайым смартфон арқылы жасауға болады. Дипфейк дәуірінде "мен өз көзіммен көрдім" деген сөз шындықтың дәлелі болудан қалды.

25 миллион долларлық алаяқтық – ең ірі оқиға

Қазіргі уақытта ең ірі әрі күрделі жағдай 2024 жылы Гонконгта тіркелген.

Бұл оқиға Arup Group компаниясының жергілікті филиалында болған. Компания Сидней опера театры мен Париждегі Помпиду орталығы сияқты әлемдік жобаларға қатысқан.

Қаржы бөлімінің қызметкері Лондондағы "қаржы директорынан" құпия түрде ақша аудару туралы хат алады. Сомасы үлкен болғандықтан, ол күмәндана бастайды. Сол кезде алаяқтар оны Zoom арқылы видеоқоңырауға шақырады.

Жәбірленуші кейін олардың "нақты адамдардай сөйлеп, дәл солар сияқты көрінгенін" айтқан.

Бұл жағдай қазіргі заманда дипфейктің құрбаны тек "сенгіш адам" емес, ірі халықаралық компания қызметкері де бола алатынын дәлелдейді.

Қазақстандағы дипфейк-алаяқтық мысалдары

Егер Гонконгтағы оқиға алыс сияқты көрінсе, мынаған мән беріңіз: мұндай алаяқтық Қазақстанда да кең таралған.

Қарапайым адамдар WhatsApp-та жұлдыздармен сөйлеседі, "ІІМ министрлерінен" видеохабарламалар алады, тіпті үйінен шықпай-ақ "голливуд жұлдыздарымен" танысып жатады.

Димаш Құдайберген қатысады делінген жалған инвестициялық жоба

Қазақстандағы ең ауқымды ЖИ-алаяқтықтардың бірі – "Қазатомпром" атын жамылып жасалған жалған инвестициялық платформа жарнамасы болды. Алаяқтар өтірігіне сендіру үшін ұлттық деңгейдегі танымал тұлғаны таңдаған – Димаш Құдайберген.

Видео бірнеше миллион қаралым жинап, қазақстандықтарға уран өндірісінен үлкен табыс уәде етті. Ең қауіпті тұсы – роликте тек әншінің өзі ғана емес, оның ата-анасы да қолданылған.

Жалған видеодан алынған стоп-кадрлар (сол жақта - Димаш Құдайберген, оң жақта - оның ата-анасы)

Жалған видеодан алынған стоп-кадрлар (сол жақта - Димаш Құдайберген, оң жақта - оның ата-анасы)

Димаш пен оның ата-анасы түсірілген жалған видео қалай жасалған?

Дипфейк жасау үшін қылмыскерлерге тіпті ештеңе түсірудің қажеті болмаған. Олар бұрыннан бар контентті "қайта орналастыру" (репозиционирование) әдісін қолданған. Видеоның бірінші бөлігі үшін Димаштың Instagram парақшасындағы көпшілікке қолжетімді жаңажылдық құттықтау видеосы алынған:

Посмотреть эту публикацию в Instagram

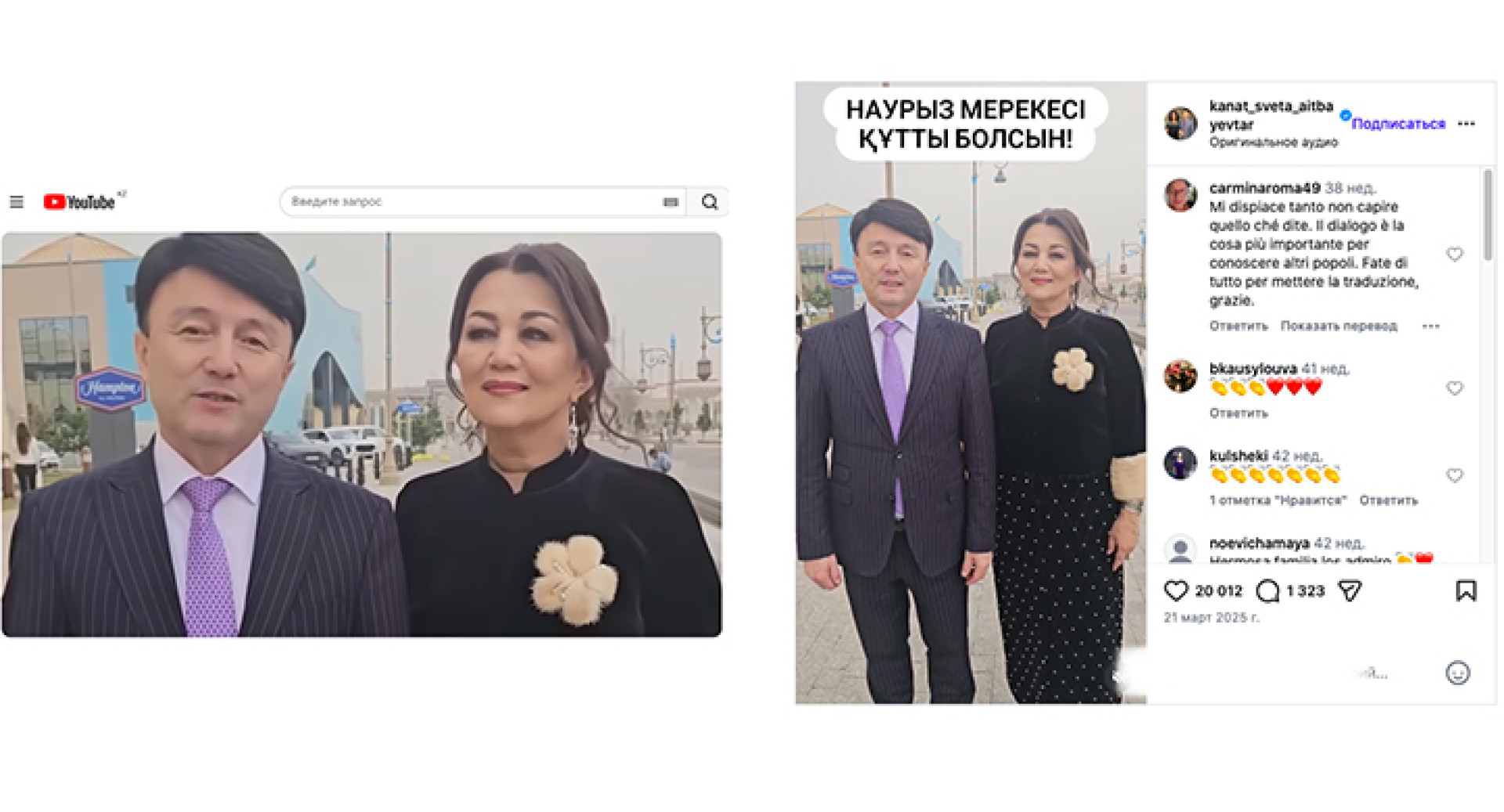

Алаяқтар Димаштың ата-анасы жоба туралы "сөйлесетін" бейнежазба кадрларын Instagram парақшасынан көшіріп алған. Түпнұсқа бейнежазбада Құдайберген отбасы қазақстандықтарды Наурыз мерекесімен құттықтаған.

Салыстыруға арналған стоп-кадрлар: сол жақта - жалған видеодан алынған кадр, оң жақта - Instagram-дағы шынайы жазбадан скриншот

Нейрожелілер көмегімен алаяқтар видеоға жаңа дыбыс қосып, ерін қозғалысын соған сәйкестендірген (яғни липсинк жасаған). Соның арқасында қарапайым жақсы тілектер күмәнді платформаға ақша салуға шақыруға айналған.

Бұл жағдай кез келген адамның жеке контенті ұрланып, жасанды интеллект арқылы өзгертіліп, қылмыс жасауға қолданылуы мүмкін екеніне айқын мысал болды.

"Киану Ривзге көмектескім келді": қазақстандықты "Голливуд жұлдызы" алдамақ болған

Егер Димаш Құдайберген атынан қазақстандықтарға инвестиция арқылы "байып кету" идеясы ұсынылса, келесі жағдайда алаяқтар адамдардың кумирге жақын болу арманына сүйенген.

2024 жылы Қостанай қаласының 62 жастағы тұрғыны классикалық алаяқтық схемасына тап болған. Барлығы әлеуметтік желідегі жазбасына қойылған лайктан басталады - оны Киану Ривз бейнесін толықтай қайталаған аккаунт қойған.

Біраз уақыттан кейін "Киану" қиын жағдайға тап болғанын айтады: сот істеріне байланысты есепшоттары бұғатталған, ал оған шұғыл түрде емделуге ақша қажет екен. Әйел кумиріне шын жүректен көмектескісі келіп, ірі соманы аударуға дайын болған.

Алайда банк қызметкерлерінің қырағылығының арқасында бұлай жасамаған: олар ақша жіберілмек болған есепшоттың белгісіз ойын компаниясына тиесілі екенін байқап, ақпаратты полицияға берген.

Бұл оқиға - жеке жағдай емес, бүкіл әлемде таралып жатқан тренд.

Еуропада Брэд Питтке байланысты ұқсас жағдай әлдеқайда қайғылы аяқталған: 53 жастағы франциялық әйел алаяқтарға 830 000 еуро аударып қана қоймай, иллюзия үшін өз отбасын да бұзған.

Цифрлық клон: алаяқтар Tengrinews.kz брендін қалай "ұрлады"

Біздің редакция да бірнеше рет киберқылмыстық схемалар нысанасына айналды. Алаяқтар адамдар белгісіз сілтемелерге сенбейтінін түсінді. Бірақ күн сайын көріп жүрген логотипке толық сенеді.

Сондықтан олар Tengrinews.kz ресми парақшаларын көшіріп, көзбен ажырату қиын болатын жалған аккаунттар жасай бастады. Барлығы ұқсас: фирмалық түстер, қаріптер, логотип, тіпті біздің журналистердің шынайы фотолары мен есімдері.

Одан кейін "жүлде ұтыстары", "әлеуметтік төлемдер" немесе "ҚҚС қайтарымдары" туралы таргеттелген жарнамалар тарады. Сенімділікті күшейту үшін қылмыскерлер дипфейк-видеоларды пайдаланған - онда танымал жаңалық жүргізушілерінің ЖИ-көшірмелері "ресми түрде" төлемдердің басталғанын хабарлаған.

Алаяқтар қайталап жасаған Tengrinews.kz сайтының жалған көшірмесі

Алаяқтар қайталап жасаған Tengrinews.kz сайтының жалған көшірмесі

Сілтемеге басқанда қолданушы банк немесе мемлекеттік орган сайтына ұқсайтын жалған сайтқа өтеді. Соңы белгілі: ол жерде пайдаланушыдан ЖСН, карта нөмірі және ең маңыздысы CVV-код сұралады. Осы сәттен бастап шотқа бақылау алаяқтардың қолына өтеді.

Жалған басылымдар тұзағына түспеу үшін не істеу керек?

Белгілі бір кезеңде редакция оқырмандарға арнайы ескерту жасауға мәжбүр болды.

Есте сақтау керек: цифрлық әлемде тіпті таныс сайттың "сыртқы көрінісіне" де сенуге болмайды. Әрқашан мына екі нәрсені тексеріңіз:

- сайттың адрес жолы (тек tengrinews.kz болуы керек, артық таңбалар мен сызықшаларсыз);

- әлеуметтік желілердегі "көк белгі" (верификация белгісі) болуы.

Ішкі көзқарас: цифрлық иллюзиялар қалай жасалады және неге біз оларға сенеміз?

Қостанай тұрғыны сөйлескен "Киану Ривз" оқиғасы да, Гонконгтағы миллиондаған доллар ұрланған жағдай да - алгоритмдердің жұмысы мен адам психологиясын терең түсінудің нәтижесі.

Нейрожелілердің күнделікті өмірімізге қаншалықты терең енгенін және шындық пен жасандыны ажырату мүмкін бе екенін түсіну үшін біз осы саланы кәсіби деңгейде білетін мамандарға жүгіндік.

Біздің сарапшылар қазіргі дипфейктер қалай жасалатынын, неге алаяқтар кәсіби психологтарға айналғанын және "өз көзіңе сену қиын болғанда" не істеу керек екенін түсіндіреді.

"Жақын уақытта тіпті мамандар да нейрожелінің жұмысын шындықтан ажырата алмайды"

Риз Есентаев - нейрожелілер арқылы сурет пен видео жасайтын нейродизайнер. Оның айтуынша, дипфейктер жасауға қолданылатын құралдар қазір ЖИ-продакшнда кеңінен пайдаланылады. Ол бөгде адамның сырт келбетін қолданудың бірнеше тәсілі бар екенін айтады:

- дайын видеоны алып, ондағы бет-әлпетті басқа адамның бет-әлпетіне ауыстыру;

- тікелей эфирде өз бетіңді өзгерту (веб-камера қосылып, нейрожеліге қажетті образ беріледі);

- видеоны толықтай жасанды интеллект арқылы нөлден жасау.

"Егер алаяқтық әрекеттер туралы айтатын болсақ, мұнда қылмыскерлер үшін үлкен мүмкіндіктер бар".

- Қазіргі кезде мамандар дипфейкті жүз пайыз дәлдікпен анықтай ала ма? - деп біз нейродизайнер Есентаевтан сұрадық.

- Бұл қолданылатын технологияға байланысты. Иә, қазірдің өзінде айырмашылықты тіпті маманның өзі әрең байқайтын технологиялар бар, - деп жауап берді ол. - Ал ЖИ-технологиялардың даму қарқынын ескерсек, жақын уақытта мамандарға да нейрожелі жасаған дүниені шынайы түсірілімнен ажырату өте қиын болады.

- Қарапайым адам, маман емес адам, жалған видеоны қалай ажырата алады?

- Бетке мұқият қарау керек, фактілерді іздеу қажет: бұлыңғыр жиектер, бет пен дененің текстурасы мен анықтығының әртүрлі болуы; анимациядағы қателіктер, табиғи емес қозғалыстар. Ең бастысы - липсинк, яғни ерін қозғалысы.

Көбінесе нейрожеліні дәл ерін қозғалысы арқылы байқауға болады, себебі сөйлесу кезінде ол өте белсенді қозғалады және дыбыспен әрдайым мінсіз сәйкес келе бермейді.

- Бұл технологияның екі жағы бар, - дейді сарапшы. - Бір жағынан, үлкен қауіптер бар: алаяқтық, жалған жаңалықтар, саяси манипуляциялар. Қазірдің өзінде президент немесе танымал блогер кез келген нәрсені айтып тұрғандай видео жасауға болады, және адамдардың 90 пайызы соған сеніп қалуы мүмкін.

Екінші жағынан, бұл - өте қуатты шығармашылық құрал. Қазір продакшнда бұрын айлап түсірілетін және миллиондаған қаражат талап ететін дүниені бірнеше күнде жасай аламыз. Актерді "жасарту", өмірде жоқ кейіпкерді жасау немесе бренд амбассадоры басқа құрлықта болса да, оның қатысуымен жарнама түсіру мүмкін.

Сондықтан бұл технологияны толықтай тыйым салу немесе қатты шектеу мағынасыз - ол бәрібір дамуын жалғастырады. Ең маңыздысы - видео енді жүз пайыз дәлел болмайтын әлемде өмір сүруді үйрену.

"Майкл Джексон" Tengrinews оқырмандарына үндеу жасайды

Технологиялардың қаншалықты дамығанын түсінудің ең жақсы жолы - оны іс жүзінде көру. Дәл қазір "поп-музыка королі Майкл Джексон" төмендегі екі видеода Tengrinews.kz оқырмандарына осы мақалаға қатысты маңызды үндеу жасайды:

Бұл ролик - біздің редакция үшін нейродизайнер Риз Есентаев арнайы жасаған жүз пайыз дипфейк.

Ол қалай жасалды?

"Мұндай роликті жасау төрт кезеңнен тұрады: бейнені генерациялау, анимация, дыбыстау және липсинк. Барлығы шамамен 30–40 минут уақыт алды", - дейді сарапшы.

"Құрбандардың ішінде ақымақ адамдар жоқ"

Біз дипфейктер қалай жасалатынын және боттар ақпараттық кеңістікті қалай толтыратынын көрдік. Бірақ ең маңызды сұрақ: бұл технологиялардың бар екенін біле тұра, неге біз әлі де алданамыз?

Киберқылмыстың "анатомиясын" түсініп, қазіргі заманғы "цифрлық ұрының" бейнесін анықтау үшін компьютерлік криминалистика саласының маманы, форензик-сарапшы Анатолий Ремнёвпен сөйлестік.

Оның жұмысы - қылмыскер жасырынуға тырысқан жерде цифрлық іздерді табу.

Біздің алғашқы сұрағымыз: 2–3 жыл бұрынғы жағдаймен салыстырғанда, Қазақстандағы кибералаяқ қалай өзгерді? Қандай жаңа құралдар пайда болды?

Маманның жауабы:

"Қарапайым алаяқтың анықтамасы тым түсініксіз. Әрбір алаяқтық схеманың артында тек қылмыскерлер ғана емес, сонымен қатар ұйымдастырушылар да тұрғанын түсінуіміз керек. Олар қарапайым интернет пайдаланушысының психологиясында әлдеқайда тәжірибелі, алдау әдістерінде шебер болады. Алаяқтықтың өзі өзгерген жоқ. Өзгергені - оның форматы. Біздің қоғамымыз цифрлық жүйеге айналды. Күнделікті өміріміздегі барлық теріс және деструктивті құбылыстар, қаншалықты таңқаларлық естілсе де, тегіс және үйлесімді түрде цифрлық экожүйеге көшті".

Егер құралдар туралы айтсақ - бұл сол баяғы әлеуметтік инженерияның төрт негізгі әдісі:

- претекстинг (яғни банктің "қауіпсіздік қызметі" деген атышулы қоңыраулар);

- фишинг (мысалы, OLX-та онлайн сатып алу кезінде "жеткізу қызметі" сілтемелері);

- "қызметке қызмет" әдісі ("техникалық қолдау", "тергеушілерден" қоңыраулар);

- және ең күрделі деңгейі - кері әлеуметтік инженерия, яғни жәбірленушінің өзі алаяқтардан "көмек сұрап" жүгінуі.

Алаяқтықтың түрі мен саласына байланысты осы классикалық әдістердің бірі таңдалып, нақты схемаға бейімделеді. Негізгі мақсат біреу - пайдаланушының сеніміне кіріп, оның өз еркімен ақшасын немесе мүлкін алу.

Мәселе мынада: алаяқтар күн сайын өз біліктілігін арттырып келеді, әсіресе профайлинг сияқты арнайы салаларда.

- Қазір Қазақстанда кең таралған, бірақ көпшілік біле бермейтін ЖИ қолданылатын бір схеманы айта аласыз ба?

- Өкінішке қарай, нақты таралу деңгейін айта алмаймын. Бірақ менің ойымша, бұл - танымал саясаткерлердің, блогерлердің, қоғамдық тұлғалардың бетбейнесі мен дауысын клондап, жоғары табысты инвестициялар немесе жоқ акцияларды жарнамалау схемасы. Мұндай видеолар әлеуметтік желілердегі жалпы жарнама ағыны ішінде шынайы көрінеді, өйткені онсыз да әртүрлі жарнамаларға үйреніп кеткенбіз.

- Қылмыс орны интернетте болғанда не болады? Компьютерлік криминалистика маманы қайда барады?

- Барлығы жағдайға байланысты. Бірақ классикалық криминалистикадағыдай, бұл да "қылмыс орнын" қарау (телефон, компьютер, сервер), дәлелдерді жинау (логтар, файлдар, жедел жад көшірмелері). Көбіне бұл қашықтан жасалады. Кейде ғана құрылғылар тұрған жерге немесе алаяқтық колл-орталыққа барып, цифрлық іздерді жоюдың алдын алу үшін әрекет жасалады.

Бірақ ерекше жағдайлар да болады: мысалы, фитнес-браслеттен деректерді тікелей адамның денесінде зерттеу арқылы өлім уақытын және жағдайларын анықтау.

- Көп адам "мені алдай алмайды, мен ақымақ емеспін" деп ойлайды. Шын мәнінде кімдер ЖИ арқылы жасалатын алаяқтықтың құрбаны болады?

- Бірден айтайын: құрбандардың ішінде ақымақ адамдар жоқ.

Көбінесе адамдар белгілі бір әлсіз сәтте алданады. Себебі алаяқтар алдымен жәбірленуші туралы ақпарат жинайды. Оның "профилі" неғұрлым толық болса, соғұрлым табысқа жету ықтималдығы жоғары.

Нақты "типтік құрбан" жоқ, бірақ мінез-құлықтық үлгілер бар:

- Бірінші орында - жүйеге толық сенетін адамдар: зейнеткерлер, құқықтық және қаржылық сауаты төмен адамдар. Оларға көбіне "банк", "тергеуші", "салық қызметі" атынан қоңырау шалу (претекстинг) тиімді.

- Екінші орында - күйзеліс, эмоциялық әлсіздік немесе асығыс адамдар. Мұндай кезде тексеруге уақыт болмайды, шешім эмоциямен қабылданады.

- Үшінші топ - әлеуметтік желіде өте белсенді адамдар. Олар интернетте өздері туралы көп ақпарат қалдырады: өмірдегі оқиғалары, достары, жүрген жерлері, суреттері. Бұл деректер кейін күрделі алаяқтық схемаларда қолданылады. Мұнда ЖИ қолдану шабуылды "мінсіз" етеді.

Посмотреть эту публикацию в Instagram

Нұсқаулық: кибералаяқтардың құрбаны болмау үшін не істеу керек?

Сарапшылармен әңгімеден шыққан басты қорытынды ойландырады: енді көз бен құлақ сенімді дәлел бола алмайды. Егер смартфон экранынан анаңыздың жүзін көрсеңіз немесе бастығыңыздың дауысын естісеңіз - бұл небәрі 30 минутта қолдан жасалуы мүмкін пиксельдер мен дыбыстар жиынтығы ғана.

Өзіңізді қорғау үшін "құрбан" рөлінен "белсенді әрекет етуші" рөліне ауысу керек. Міне, нақты алгоритм:

1. "Қарсы әрекет" ережесі: бастаманы өз қолыңызға алыңыз

Егер сізге (мессенджерде немесе телефон арқылы) хабарласып, ақша сұраса, жол апаты, оықс оқиғамен қорқытса немесе "инвестиция" ұсынса:

- Қоңырауды тоқтатыңыз. Әңгіме барысында алаяқты әшкерелеуге тырыспаңыз - көбіне мұндай жерде кәсіби психологтар (профайлерлер) жұмыс істейді.

- Өзіңіз қайта хабарласыңыз. Бірақ сол арна арқылы емес! Егер WhatsApp-та хабарласса - кәдімгі ұялы телефонмен қоңырау шалыңыз. Егер телефоннан қоңырау шалса - Telegram-да жазыңыз.

- Жеке құпия сөз. Жақындарыңызбен "код сөз" келісіп алыңыз (мысалы, әжеңіздің қыз кезіндегі тегі немесе алғашқы итіңіздің аты). Егер ол әлеуметтік желіде жоқ болса, ешбір ЖИ оны біле алмайды.

2. Асығыстыққа жол бермеңіз

Алаяқтар әрқашан уақыт тапшылығын қолданады ("қазір жасау керек!", "5 минуттан кейін шот бұғатталады!").

10 минут үзіліс жасаңыз. Қарапайым түрде телефонды қойып, су ішіңіз. Осы уақыт ішінде эмоция басылып, жағдайды нақты бағалай аласыз.

Есте сақтаңыз: ешбір ресми орган маңызды мәселені 5 минут ішінде телефон арқылы шешпейді.

3. Сілтемелер мен "цифрлық іздер" гигиенасы

Нейрожелілерге "жем" бермеңіз. Ашық қолжетімді жерде сапалы сурет мен аудиожазбаларыңыз неғұрлым аз болса, сіздің "көшірмеңізді" жасау соғұрлым қиын.

Мұқият тексеріңіз. Нейродизайнердің кеңесін есте сақтаңыз: деректерді іздеңіз. Біртүрлі мимика, шаштың бұлдырап, анық көрінбеуі, күмәнді липсинк (дауыс пен ерін сәйкес келмейді). Егер видео "тым мінсіз" немесе керісінше сәл "бұзылып тұрғандай" көрінсе - бұл жалған болуы мүмкін.

Егер тікелей сөйлесіп тұрсаңыз, сұхбаттасушыдан бетін жауып, қолын бұлғауын немесе басын бұруын сұраңыз - кейбір технологияларда (бәрінде емес) бұл әлі де көмектеседі.

4. БАҚ пен брендтерге қатысты "күдік фильтрі"

Tengrinews.kz сайтында төлемдер туралы жаңалық көрдіңіз бе - браузердегі мекенжайды тексеріңіз. Егер онда tengri-news.com немесе tengrinews.kz.web.ru сияқты жазылса - бұл фишинг. Нақты адрес тек біреу: tengrinews.kz.

"Өз көзіңе сенбе". Қорытынды

Өткен ғасырда Козьма Прутков айтқан афоризм кең тараған:

"Егер піл тұрған торда "буйвол" деп жазылған тақтайша көрсең - көзіңе сенбе".

2026 жылы бұл сөздің мағынасы өзгерді. Тіпті "піл" деп жазылып, пілге ұқсап тұрған нәрсе де шын мәнінде піл болмауы мүмкін. Айтпақшы, кейін Козьма Прутковтың өзі де ойдан шығарылған кейіпкер екені белгілі болды. Бұл атты бір топ жазушы қолданған.

Бүгінде видео мен сурет шындықтың дәлелі емес - керісінше, ойын алаңы мен өнер түріне айналды. Бұл алаңдатады: енді нақты неге сенуге болатыны түсініксіз.

Болашақта әр әрекет үшін көп деңгейлі тексеруден өту керек бола ма? "Ақиқат министрлігі" пайда бола ма? Әлде біз бұрынғыдай тек тірі куәгерлерге ғана сенеміз бе?

Ал әзірге қарапайым ережелер бар:

- мұқият болу;

- ақпаратты қайта тексеру;

- және есте сақтау: егер сізге Брэд Питт хабарласса - оған сіздің махаббатыңыз емес, CVV-кодыңыз керек болуы мүмкін.

Авторы: Юлия Колмогорова

Дайындаған: Дина Шәріпхан